L’AI Act (Regolamento Europeo sull’intelligenza artificiale) è un testo legislativo approvato in Parlamento Europeo il 13/03/24, con 523 voti favorevoli, 46 contrari e 49 astenuti.

Si tratta del primo regolamento completo al mondo che disciplina lo sviluppo, l’immissione sul mercato e l’utilizzo dell’intelligenza artificiale nell’UE.

Perchè l’AI Act è fondamentale

La nuova proposta di legge mira a tutelare gli utenti, regolando l’uso e lo sviluppo dell’intelligenza artificiale nei paesi europei. Le norme del testo legislativo sono state proposte per garantire che l’AI venga sviluppata eticamente, in totale sicurezza e trasparenza, nel rispetto dei diritti fondamentali.

Le norme proposte e discusse in Parlamento Europeo

Le direttive proposte, come spiega la Commissione Europea, prevedono di:

- Affrontare i rischi creati dalle applicazioni AI

- Vietare pratiche AI che comportano rischi inaccettabili

- Definire un elenco di applicazioni AI ad alto rischio e stabilirne i giusti obblighi e requisiti

- Richiedere una valutazione della conformità prima che che un dato sistema AI venga messo in servizio o immesso sul mercato

- Istituire una struttura di governance a livello europeo (European AI office) e nazionale.

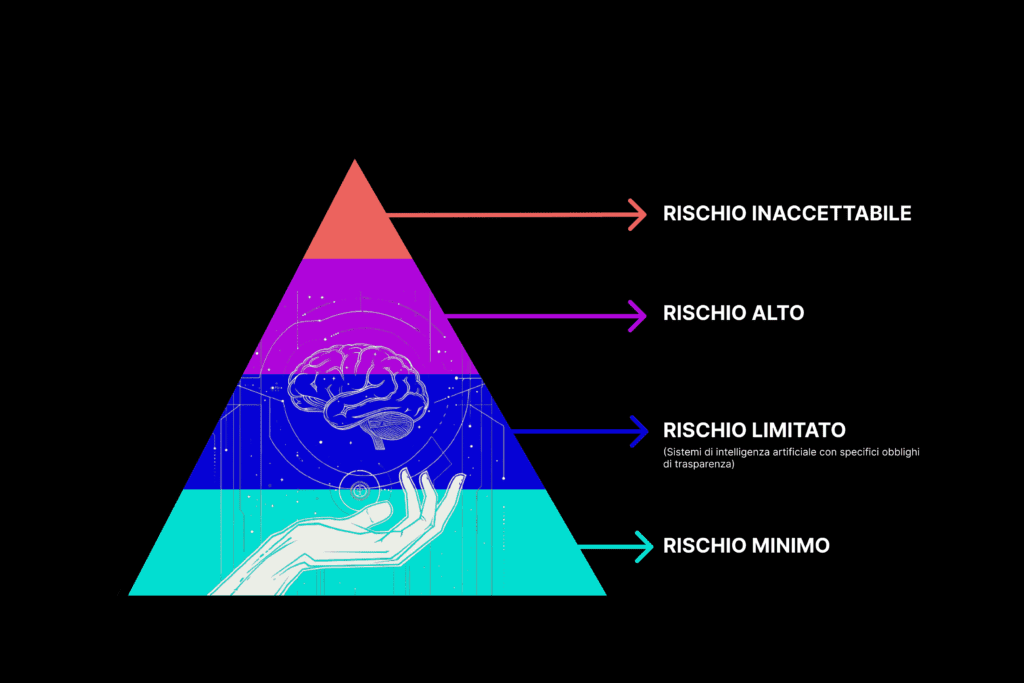

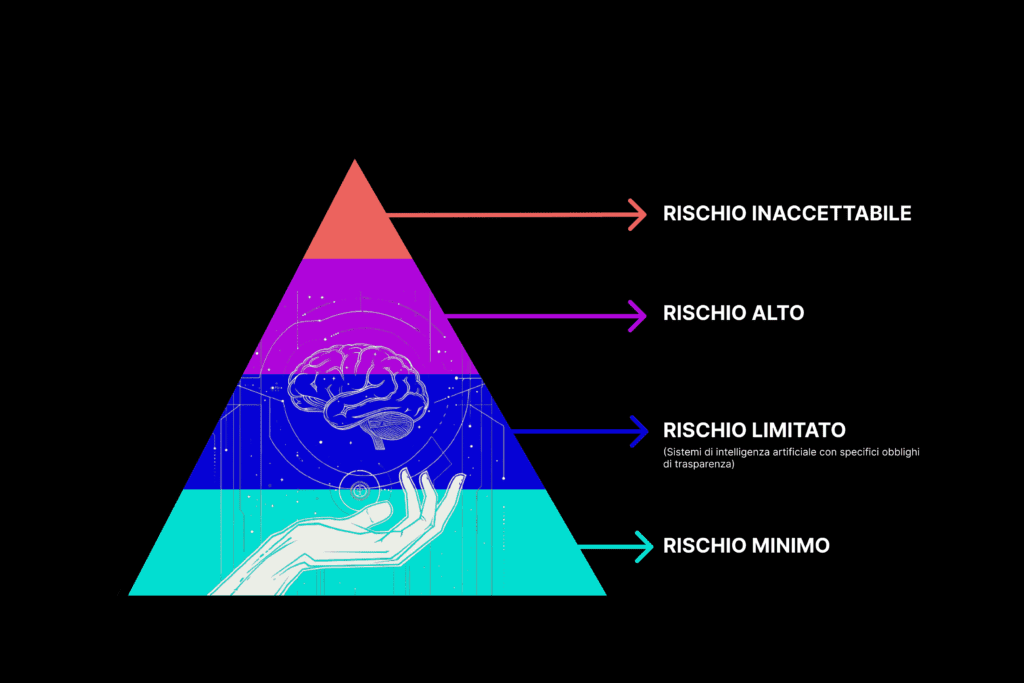

I livelli di rischio dei sistemi AI

L’AI Act è un regolamento “di proporzionalità”. Le sue disposizioni sono tarate in modo da essere proporzionate al livello di rischio associato al sistema di intelligenza artificiale in questione. Ciò significa che i sistemi a basso rischio saranno soggetti a requisiti meno onerosi rispetto ai sistemi ad alto rischio.

La legge assegna le applicazioni dell’AI a tre categorie di rischio: rischio inaccettabile, rischio alto, rischio limitato, rischio minimo e nullo. Le applicazioni e i sistemi che rientrano nel basso rischio non esplicitamente vietate o elencate e sono in gran parte non regolamentate

La lista completa dei sistemi AI vietati, contrari ai diritti fondamentali dell’uomo, è descritta nel dettaglio nell’High Level Summary dell’AI Act

Rischio elevato

Come spiegato dalla Commissione Europea, i sistemi AI ad alto rischio includono quelli impiegati in:

- Infrastrutture critiche, come i trasporti, che possono implicare rischi per la vita e la salute dei cittadini

- Settori dell’istruzione, che influenzano l’accesso alla fromazione e alle opportunità professionali

- Componenti di sicurezza dei prodotti, ad esempio nell’applicazione dell’IA in chirurgia robotizzata

- Ambiti lavorativi, gestione delle risorse umane e selezione del personale

- Servizi essenziali, come l’accesso al credito

- Applicazione della legge, con possibili impatti sui diritti fondamentali delle persone

- Controllo delle frontiere, asilo e gestione della migrazione

- Amministrazione della giustizia e processi democratici

Questi sistemi saranno soggetti a obblighi rigorosi. L’identificazione biometrica a distanza è considerata ad alto rischio e soggetta a restrizioni, con eccezioni per specifiche circostanze.

Rischio limitato, minimo o nullo

L’applicazione e i sistemi AI devono essere trasparenti. La legge introduce precisi obblighi di trasparenza per garantire che gli utenti siano pienamente informati, se stanno leggendo un testo, ascoltando e vedendo un contenuto audio o video generato dall’AI. I fornitori dovranno quindi garantire che tali contenuti siano identificabili.

Il regolamento consente l’uso gratuito dell’AI a rischio minimo.

Conclusione

L’AI Act è simbolo di un traguardo importante per garantire che l’intelligenza artificiale sia sviluppata e utilizzata in modo da beneficiare l’intera società europea.

Il Regolamento contribuirà a creare un ecosistema AI incentrato sull’eccellenza e sulla fiducia, che stimolerà l’innovazione e la crescita economica, pur proteggendo i diritti e i valori fondamentali dell’UE.

Per leggere il documento completo del regolamento in lingua italiana cliccare qui.

Sviluppa un’AI etica in azienda. Compila il form per un primo confronto gratuito.